Tóm tắt ngắn

- Google đã ra mắt Gemma 4, một họ mô hình mở được phát hành theo giấy phép Apache 2.0.

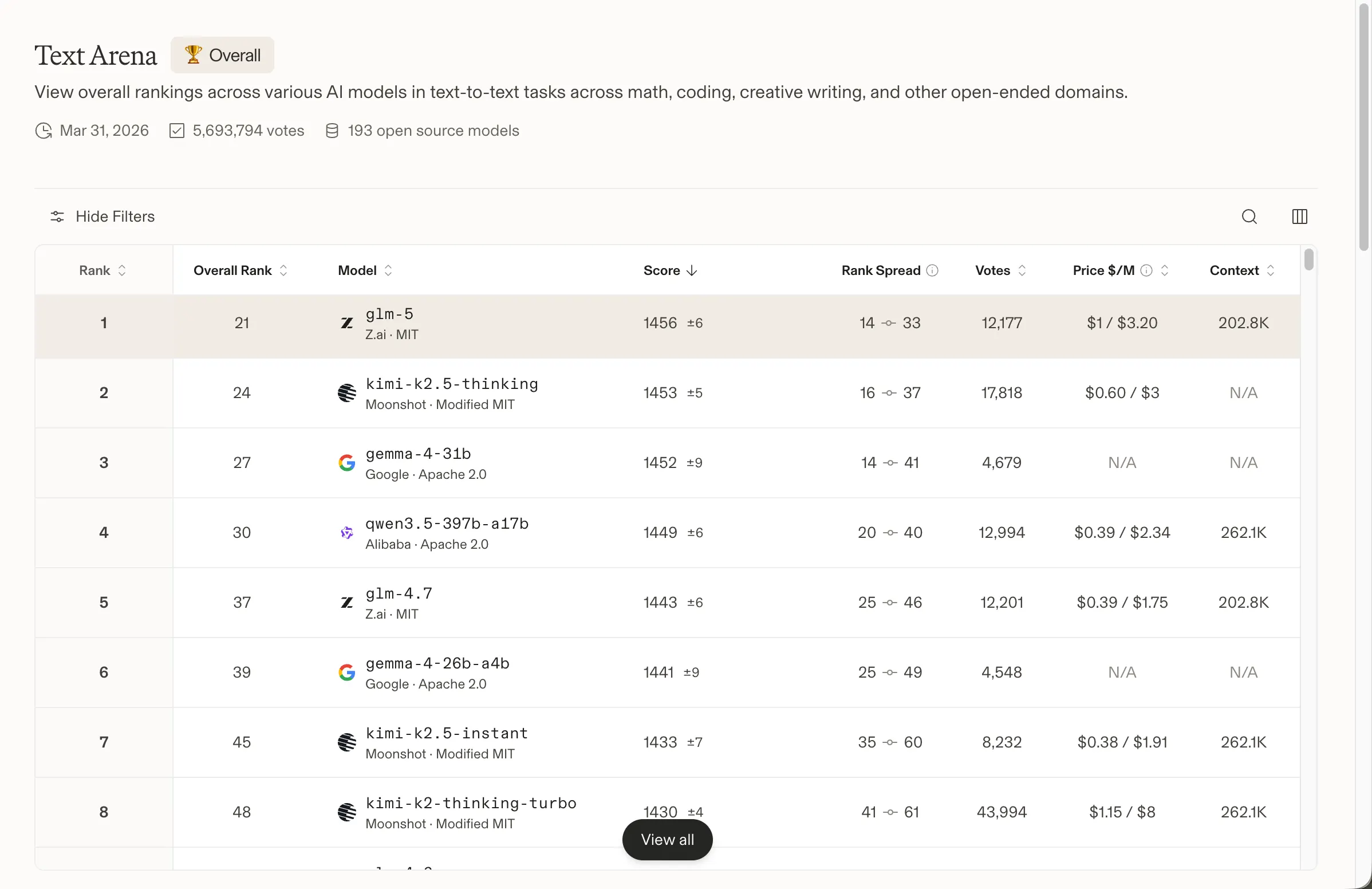

- Dòng sản phẩm gồm 4 mô hình này trải dài từ thiết bị di động đến trung tâm dữ liệu, trong đó bản 31B đã vươn lên xếp hạng #3 toàn cầu.

- AI mã nguồn mở tại Mỹ nhận được cú hích cần thiết, khi Gemma 4 — với sự hậu thuẫn của DeepMind — đang tự định vị là đối thủ Mỹ mạnh nhất trước DeepSeek, Qwen và các tên tuổi dẫn đầu khác từ Trung Quốc.

Tham vọng AI mở của Google hôm nay đã trở nên nghiêm túc hơn rất nhiều. Công ty đã phát hành Gemma 4, một họ gồm 4 mô hình open-weight được xây dựng trên cùng nền tảng nghiên cứu với Gemini 3, đồng thời được cấp phép theo Apache 2.0 — một bước chuyển đáng kể so với các điều khoản hạn chế hơn ở những phiên bản Gemma trước đó.

Các thế hệ Gemma trước đây đã được giới phát triển tải xuống hơn 400 triệu lần, tạo ra hơn 100.000 biến thể từ cộng đồng. Và đây là bản phát hành tham vọng nhất từ trước đến nay.

Chúng tôi vừa phát hành Gemma 4 — dòng mô hình mở thông minh nhất của chúng tôi cho đến nay.

Được xây dựng trên cùng nền tảng nghiên cứu đẳng cấp thế giới như Gemini 3, Gemma 4 mang năng lực trí tuệ đột phá trực tiếp lên chính phần cứng của bạn để phục vụ các tác vụ suy luận nâng cao và quy trình agentic.

Được phát hành theo giấy phép thương mại… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) April 2, 2026

Trong suốt một năm qua, bảng xếp hạng AI mã nguồn mở gần như là sân chơi của Trung Quốc. DeepSeek, Minimax, GLM và Qwen đã chiếm lĩnh các vị trí dẫn đầu, khiến những lựa chọn thay thế từ Mỹ phải chật vật tìm chỗ đứng. Như Decrypt từng đưa tin vào năm ngoái, các mô hình mở của Trung Quốc đã đi từ mức chỉ khoảng 1,2% mức sử dụng mô hình mở toàn cầu vào cuối năm 2024 lên khoảng 30% vào cuối năm 2025, trong đó Qwen của Alibaba thậm chí còn vượt qua Llama của Meta để trở thành mô hình self-hosted được sử dụng nhiều nhất trên thế giới.

Llama của Meta trước đây từng là lựa chọn mặc định cho các nhà phát triển muốn một mô hình đủ mạnh và có thể chạy cục bộ. Nhưng danh tiếng đó đã dần phai nhạt — giấy phép do Meta kiểm soát của Llama làm dấy lên nghi vấn về việc liệu nó có thực sự là mã nguồn mở hay không, đồng thời hiệu năng của nó cũng tụt lại phía sau so với các đối thủ Trung Quốc. Dòng OLMo của Allen Institute từng cố lấp khoảng trống này nhưng không tạo được lực kéo đáng kể. OpenAI đã phát hành các mô hình gpt-oss vào tháng 8/2025, qua đó mang lại một làn gió mới cho hệ sinh thái, nhưng chúng chưa bao giờ được thiết kế để cạnh tranh ở nhóm frontier model.

Và mới hôm qua, Arcee AI — một startup Mỹ chỉ có 30 nhân sự — đã phát hành Trinity, một mô hình mở 400 tỷ tham số, qua đó đưa ra lập luận khá thuyết phục rằng hệ sinh thái Mỹ chưa hoàn toàn “chết lâm sàng”. Gemma 4 tiếp nối đà đó, nhưng lần này có thêm toàn bộ sức nặng của Google DeepMind đứng sau, biến nó thành ứng viên có thể xem là mô hình Mỹ tốt nhất trong bối cảnh AI mã nguồn mở hiện nay.

Google cho biết mô hình này được “xây dựng từ cùng nền tảng nghiên cứu và công nghệ đẳng cấp thế giới như Gemini 3”. Gemma 4 được phát hành với 4 kích cỡ: bản Effective 2B và 4B dành cho điện thoại và thiết bị edge, bản 26B Mixture of Experts tập trung vào tốc độ, và bản 31B Dense được tối ưu cho chất lượng đầu ra thuần túy.

Hiện tại, bản 31B Dense đang xếp hạng thứ 3 trong số tất cả các mô hình mở trên bảng xếp hạng text của Arena AI. Bản 26B MoE đứng thứ 6. Google khẳng định cả hai đều vượt trội so với những mô hình lớn gấp 20 lần kích thước của chúng — và tuyên bố này nhìn chung khá phù hợp với số liệu từ Arena AI, dù các mô hình Trung Quốc vẫn đang nắm giữ 2 vị trí dẫn đầu.

Chúng tôi đã thử nghiệm Gemma 4. Mô hình này khá có năng lực, nhưng vẫn đi kèm một số điểm cần lưu ý. Nó có xu hướng áp dụng cơ chế suy luận ngay cả với những tác vụ không thực sự cần đến reasoning, khiến câu trả lời đôi khi mang cảm giác bị “thiết kế quá mức” đối với các prompt đơn giản. Khả năng viết sáng tạo ở mức ổn — dùng được, nhưng chưa thật sự truyền cảm hứng — và nhiều khả năng sẽ cải thiện nếu có hướng dẫn cụ thể hơn cùng prompt engineering tốt hơn.

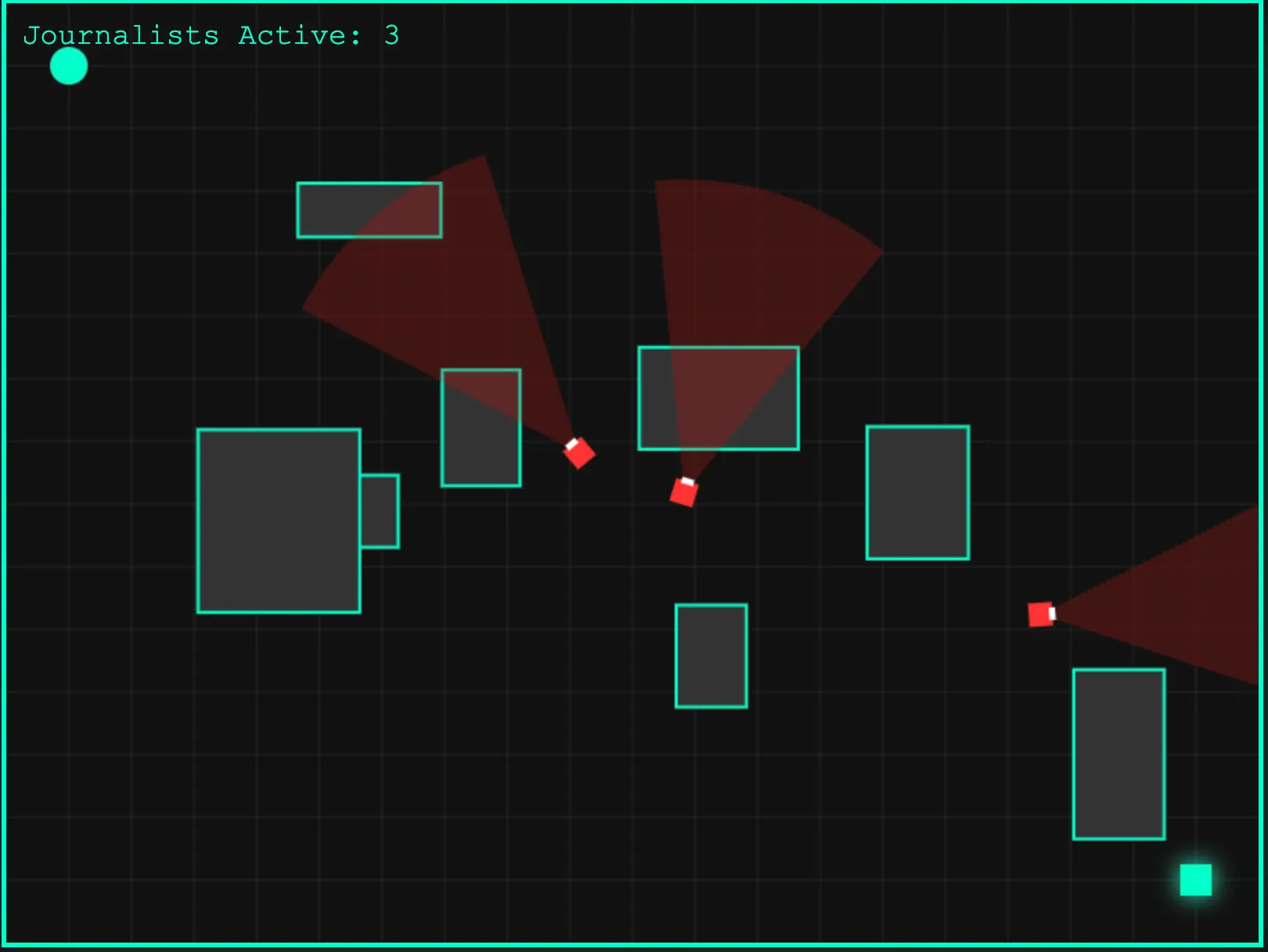

Điểm mà mô hình thể hiện rõ ràng nhất là ở mảng code. Khi được yêu cầu tạo một trò chơi, đầu ra không quá hào nhoáng hay phức tạp, nhưng lại chạy được ngay từ lần thử đầu tiên mà không phát sinh lỗi. Với một mô hình 41 tỷ tham số, đó là kết quả không tệ. Độ tin cậy zero-shot như vậy có lẽ còn giá trị hơn một sản phẩm trông đẹp mắt hơn nhưng lại cần debug.

Bạn có thể thử trò chơi này tại đây (cơ bản nhưng vẫn hoạt động tốt).

Bốn biến thể này bao phủ toàn bộ dải phần cứng. Các model E2B và E4B được thiết kế cho điện thoại Android, Raspberry Pi và các thiết bị edge, có thể chạy hoàn toàn offline với độ trễ gần như bằng 0, hỗ trợ đầu vào âm thanh native và cửa sổ ngữ cảnh 128K. Trong khi đó, các model 26B và 31B hướng đến workstation và triển khai trên cloud, mở rộng context lên 256K, đồng thời bổ sung function-calling native và đầu ra JSON có cấu trúc để xây dựng các autonomous agent. Cả bốn model đều xử lý hình ảnh và video ở mức native. Trọng số full-precision của các model lớn hơn có thể nằm gọn trên một GPU NVIDIA H100 80GB duy nhất; còn các phiên bản quantized thì có thể chạy trên phần cứng tiêu dùng.

Giấy phép Apache 2.0 là điểm nhấn lớn còn lại. Các bản phát hành Gemma trước đây của Google sử dụng giấy phép tùy chỉnh, gây ra sự mơ hồ về mặt pháp lý đối với các sản phẩm thương mại. Apache 2.0 loại bỏ hoàn toàn điểm vướng này — nhà phát triển có thể chỉnh sửa, phân phối lại và thương mại hóa mà không phải lo Google sẽ thay đổi điều khoản về sau. Đồng sáng lập Hugging Face, Clement Delangue, đã khen ngợi quyết định này, cho rằng “AI cục bộ đang đến thời của nó” và đó là tương lai của ngành AI. CEO Google DeepMind, Demis Hassabis, còn đi xa hơn khi gọi Gemma 4 là “những mô hình mở tốt nhất thế giới trong từng phân khúc kích thước tương ứng của chúng.”

Rất hào hứng ra mắt Gemma 4: những mô hình mở tốt nhất thế giới trong từng phân khúc kích thước tương ứng. Dòng này có 4 kích cỡ và đều có thể fine-tune cho tác vụ riêng của bạn: bản 31B dense cho hiệu năng thô vượt trội, bản 26B MoE cho độ trễ thấp, cùng các bản effective 2B và 4B dành cho thiết bị edge — chúc bạn xây dựng được nhiều thứ hay ho!

— Demis Hassabis (@demishassabis) April 2, 2026

Đó là một tuyên bố rất mạnh. Các hệ thống độc quyền từ Anthropic, OpenAI và ngay cả Gemini của chính Google vẫn đang dẫn đầu ở những bài benchmark khó nhất. Nhưng với các mô hình open-weight mà bạn có thể chạy cục bộ, tự do chỉnh sửa và triển khai trên hạ tầng của riêng mình thì cuộc cạnh tranh giờ đây đã thưa đi đáng kể. Bạn có thể trải nghiệm Gemma 4 ngay trong Google AI Studio (bản 31B và 26B) hoặc Google AI Edge Gallery (bản E2B và E4B). Trọng số mô hình cũng đã có mặt trên Hugging Face, Kaggle và Ollama.

Bản tin Daily Debrief

Bắt đầu mỗi ngày với những tin tức nổi bật nhất ở thời điểm hiện tại, cùng các bài viết gốc, podcast, video và nhiều nội dung khác.